EEUU coquetea con el fascismo digital facilitando la vigilancia masiva mediante IA

Encerrona tecnológica a la población de Estados Unidos: control fronterizo para acceder a Internet, identificación obligatoria para usar un ordenador, y vigilancia a través de inteligencia artificial.

Varias noticias de la última semana muestran señales preocupantes sobre el papel de la tecnología en una sociedad estadounidense cada vez más neurotizada. OpenAI firma un acuerdo con el Pentágono, y un proyecto de ley en California pide control de edad a nivel de sistema operativo en cualquier ordenador. Veamos qué ocurre:

ChatGPT, al servicio del Pentágono (y de Trump)

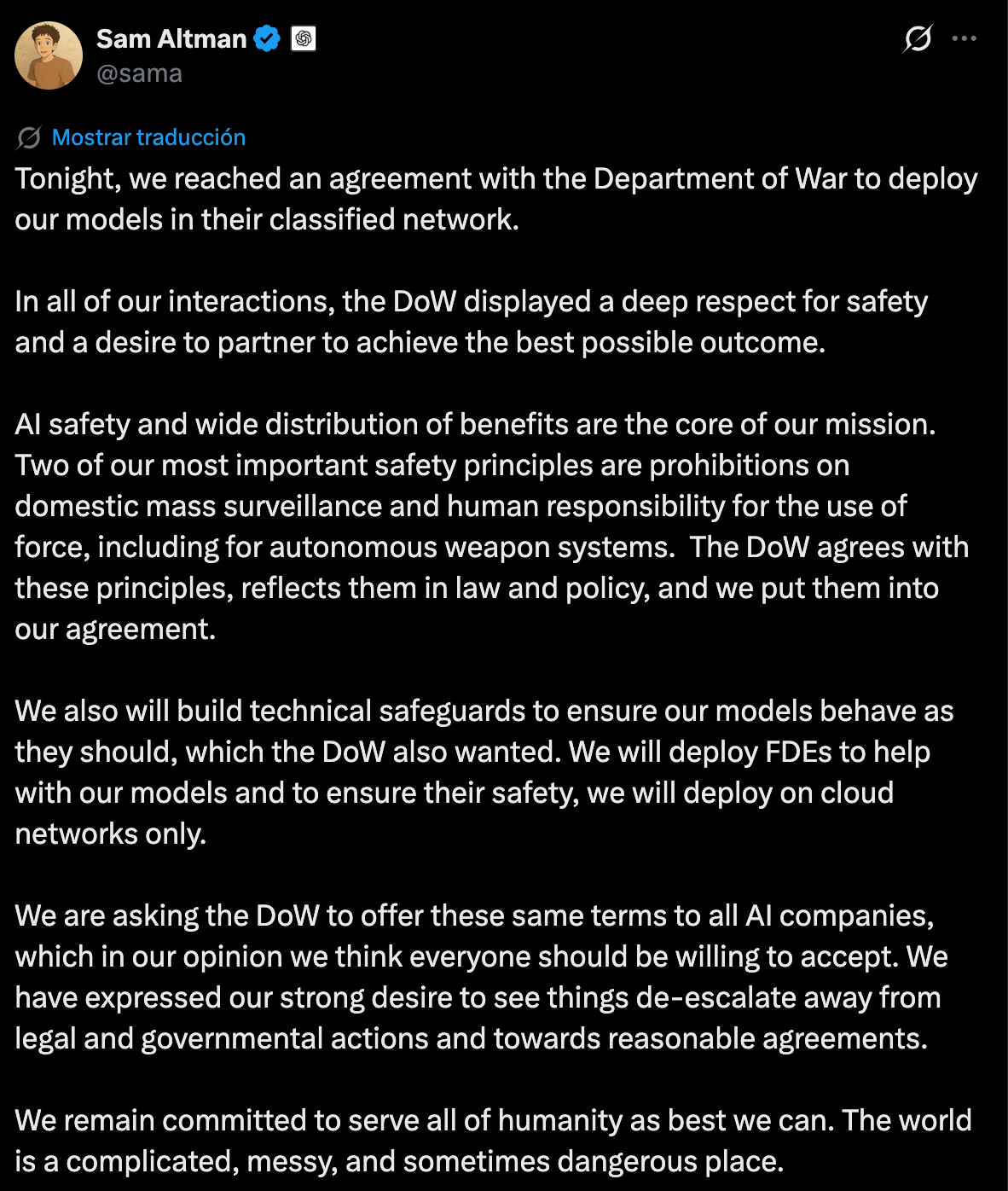

En primer lugar, algo muy importante que cambia para siempre la manera en la que entendemos el papel de la inteligencia artificial en nuestras sociedades. Sam Altman, CEO de OpenAI (ChatGPT) anunció en X el 28 de febrero que habían alcanzado un acuerdo con el Ministerio de Defensa estadounidense para cederles su tecnología de inteligencia artificial para sus usos confidenciales.

Altman aseguró guardar un respeto por los derechos civiles indicando:

“Dos de nuestros principios de seguridad más importantes son la prohibición de la vigilancia masiva nacional y la responsabilidad humana por el uso de la fuerza, incluyendo los sistemas de armas autónomas. El Departamento de Guerra coincide con estos principios, los refleja en la legislación y las políticas, y los incorporamos en nuestro acuerdo”.

Pese a este disclaimer, destaca el hecho de que Dario Amodei, el CEO de uno de sus principales competidores (Anthropic, creadora del chatbot Claude), emitió un comunicado solo dos días antes denunciando que, tras mantener conversaciones similares con el Departamento de Guerra, rechazaron firmar un acuerdo precisamente por objeciones al uso de IA para la “vigilancia doméstica masiva” y a las “armas completamente autónomas”.

Como recuerda Amodei, Anthropic lleva colaborando desde el principio con el Pentágono y, de hecho, Claude está ya “ampliamente desplegado en el Departamento de Guerra y otras agencias de seguridad nacional para aplicaciones de misión crítica, como análisis de inteligencia, modelado y simulación, planificación operativa, operaciones cibernéticas y más”1.

Pese a esto, Trump acaba de declararle la guerra a Anthropic y a solicitar el cese de su uso en todas las administraciones del país2. El motivo es que desde la compañía se niegan a ofrecer tecnología que puede ser usada para la vigilancia masiva. Como dicen desde la firma:

“La vigilancia masiva impulsada por IA presenta riesgos graves y novedosos para nuestras libertades fundamentales. […] Por ejemplo, bajo la ley actual, el gobierno puede adquirir registros detallados de los movimientos, la navegación web y las asociaciones de los estadounidenses de fuentes públicas sin necesidad de una orden judicial. […] La potente IA permite recopilar estos datos dispersos e inofensivos individualmente para obtener una imagen completa de la vida de cualquier persona, de forma automática y a gran escala”.

Ante estos peligros potenciales, desde Anthropic aplican unas restricciones en sus modelos que impedirían su uso para estos fines. Esto no le parece bien al Pentágono, que reclama poder utilizar estas tecnologías de cualquier manera que sea legal (any lawful use)3.

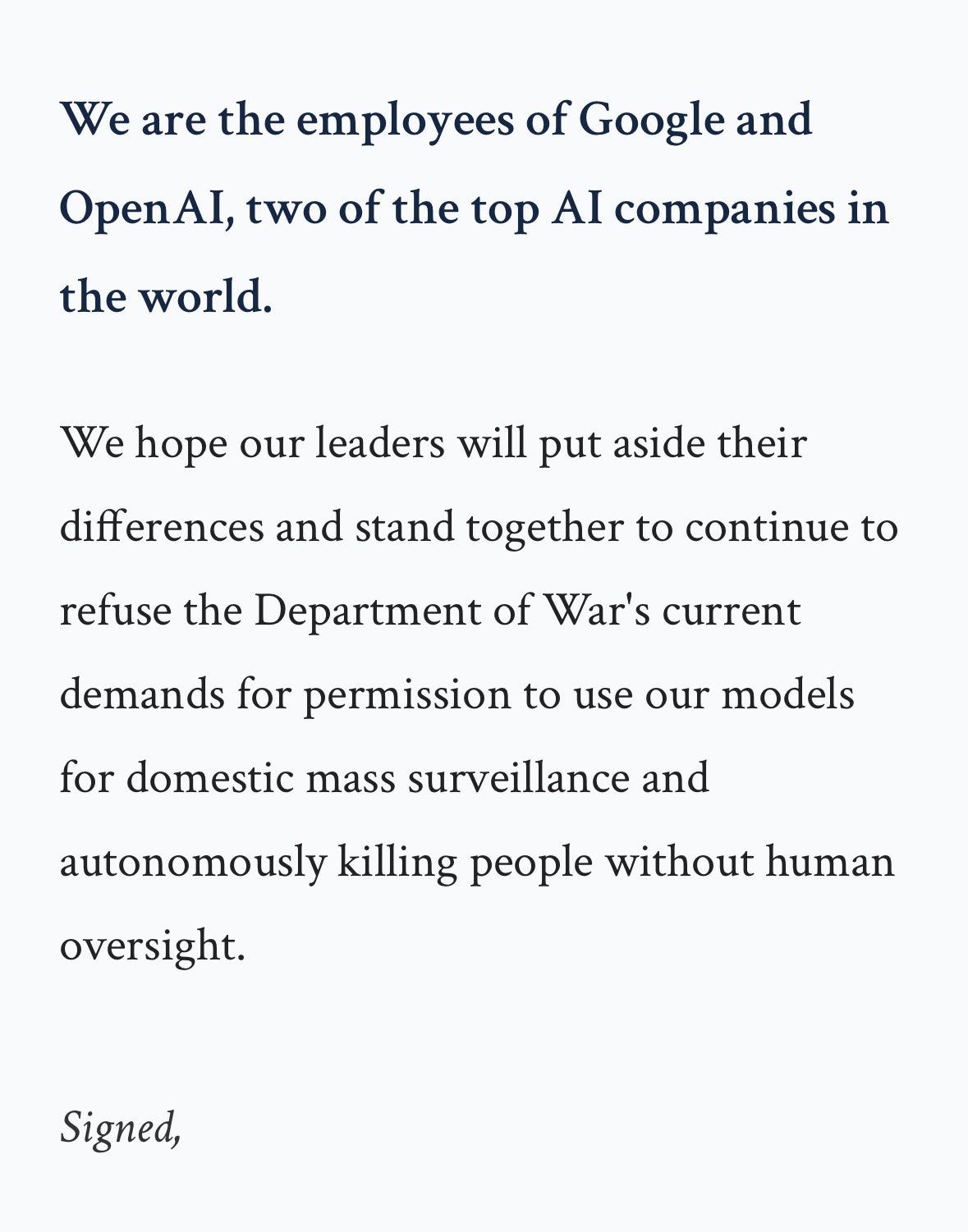

“Somos empleados de Google y OpenAI, dos de las principales empresas de inteligencia artificial del mundo.

Esperamos que nuestros líderes dejen de lado sus diferencias y se mantengan unidos para seguir rechazando las exigencias actuales del Departamento de Guerra de permitir el uso de nuestros modelos para la vigilancia masiva nacional y el asesinato autónomo de personas sin supervisión humana”.

Esto es lo que no le sienta bien a Amodei, ni tampoco a otros cientos de trabajadores de Google y OpenAI, que han firmado una carta abierta4 en contra de esta exigencia del Departamento de Guerra para poder explotar la IA a su antojo mientras que se mantengan dentro de la ley, pese a que, como alerta Amodei, la regulación se encuentra muy retrasada frente a las actuales capacidades de esta tecnología.

La carta ya ha sido refrendada por 612 actuales trabajadores de Google y 96 empleados de OpenAI.

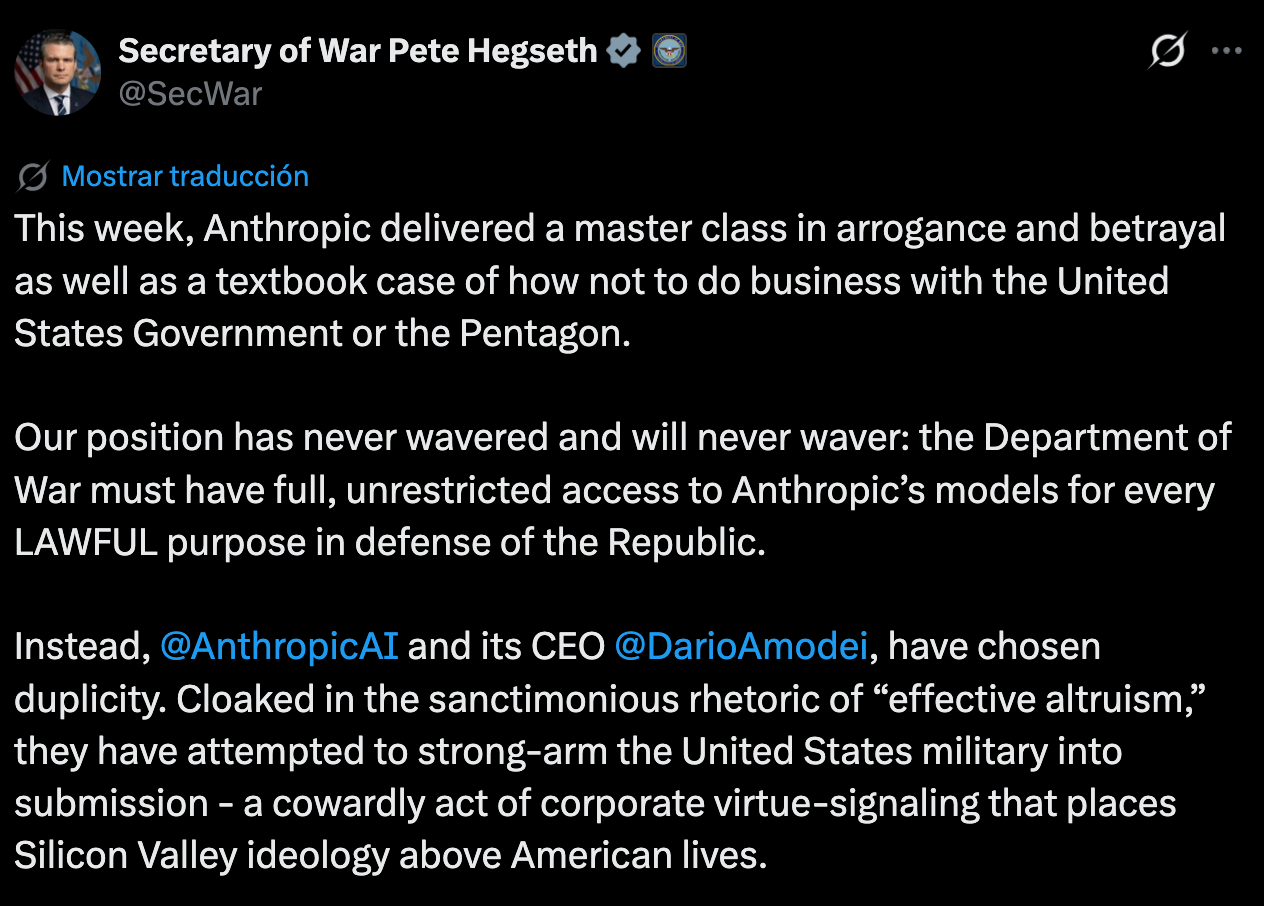

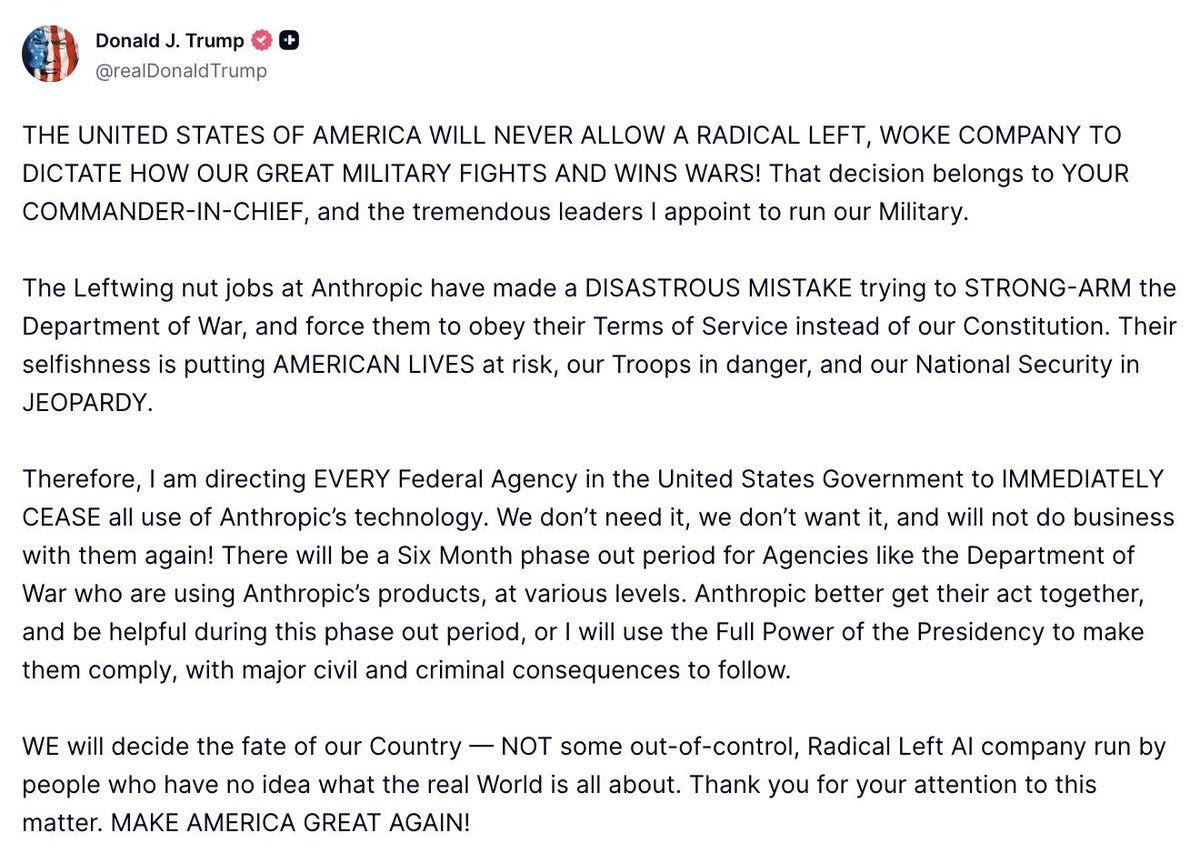

Como castigo a los de Anthropic, Trump les ha tildado de “compañía woke de extrema izquierda”, y ordenó el pasado viernes 27 de febrero a todas las agencias federales que dejasen de utilizar su tecnología en un plazo de seis meses, con el daño económico que eso implica. Asimismo, el secretario de Defensa Pete Hegseth ha calificado a la compañía de “riesgo de cadena de suministro para la seguridad nacional”, una acusación bastante grave y reservada para empresas como la china Huawei.

OpenAI ha tomado un camino diferente y sí ha llegado a un acuerdo con el Pentágono, aunque inicialmente Sam Altman respaldó en televisión a Amodei, señalando que "a pesar de todas las diferencias que tengo con Anthropic, en su mayoría confío en ellos como empresa y creo que realmente les importa la seguridad”5.

“Esta semana, Anthropic ofreció una lección magistral de arrogancia y traición, además de un ejemplo clásico de cómo no hacer negocios con el Gobierno de Estados Unidos ni con el Pentágono.

Nuestra postura nunca ha flaqueado y nunca flaqueará: el Departamento de Guerra debe tener acceso total e irrestricto a los modelos de Anthropic para cualquier propósito LEGAL en defensa de la República.

En cambio, Anthropic y su director ejecutivo, Dario Amodei, han optado por la duplicidad. Amparados en la retórica santurrona del “altruismo efectivo”, han intentado someter a las fuerzas armadas estadounidenses mediante la presión, un acto cobarde de presunción corporativa que antepone la ideología de Silicon Valley a la vida de los estadounidenses”.

Como decíamos, según Altman el acuerdo de OpenAI con el Department of War incluye líneas rojas, pero esto no sería cierto según las declaraciones del Subsecretario de Asistencia Exterior, Asuntos Humanitarios y Libertad Religiosa Jeremy P. Lewin, quien en Twitter señaló que el acuerdo no se sale de la línea definida por el Pentágono de poder usar la IA para cualquier uso dentro de la ley.

“Para evitar dudas, el contrato OpenAI - Dept. of War fluye a partir de la piedra de toque del “uso legal total” en la que el DoW ha insistido legítimamente y xAI (Grok) ha aceptado”, dijo Lewin6.

Según este funcionario, lo que cambia entre Anthropic y OpenAI es que, de seguirse las exigencias de Amodei, los sistemas sensibles estadounidenses estarían ligados a una visión moral subjetiva del CEO de una empresa privada, mientras que bajo la lente de OpenAI, es correcto que la única limitación la ponga la ley ya que esta es una fuente más democrática que la visión particular de un CEO.

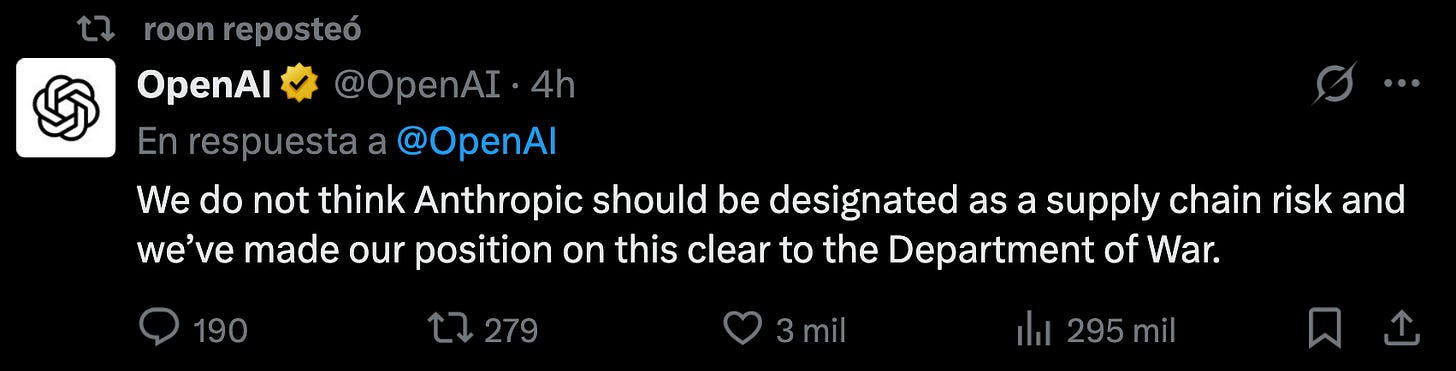

Este domingo, la cuenta oficial de OpenAI en X publicó un tuit en apoyo a Anthropic, señalando que no creen adecuado designarles como riesgo para la seguridad nacional.

Evidentemente, esta segunda lectura puede ser una tergiversación del concepto de lo democrático en favor de un uso, en la práctica, ilimitado y peligroso de la inteligencia artificial. Estados Unidos coquetea con el fascismo digital: el uso de la IA para el beneficio del proyecto supremacista MAGA.

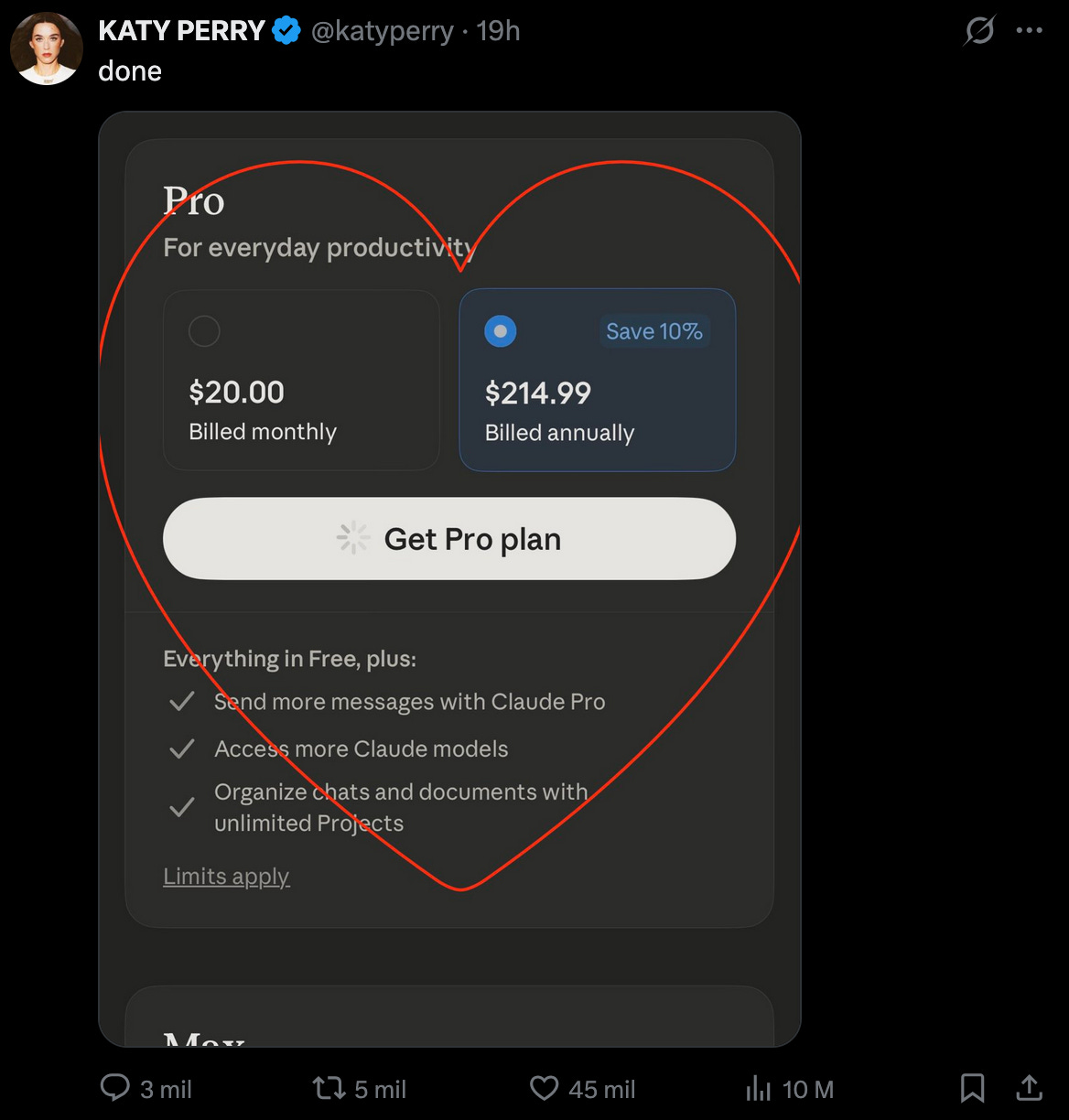

Así pues, el drama está servido e incluso figuras de la cultura pop, como Katy Perry, han reaccionado mostrando su apoyo a Anthropic. En concreto, la cantante compartió una foto en X mostrando que se desuscribía de ChatGPT y pasaba a suscribirse a Claude. Es probable por tanto que OpenAI sufra un boicot y que esta colaboración con el Pentágono le cause una caída de suscripciones.

Mientras tanto, Anthropic busca mostrarse al mundo como el faro moral de la industria de la IA, pese a que esta empresa tiene un contrato de colaboración con Palantir7, compañía que arrastra enormes polémicas y críticas por sus contratos militares. Es más: los límites marcados por Anthropic ni siquiera son exactamente morales. Tal y como indican en la carta, no es que estén en contra de la existencia de armas de destrucción completamente autónomas, sino que simplemente adiverten que la tecnología aún no está lo suficientemente avanzada.

Así todo, lo que está claro es que la IA entra en juego en el campo de guerra, y que el Pentágono podrá usar la tecnología de OpenAI en territorio enemigo. En realidad, la IA de Claude ya se usó en la captura de Maduro8. Su uso en este sentido parece quedar ajeno a toda duda ética, siendo la única “línea roja”9 para algunos el uso de la misma en el propio hogar, en el plano doméstico.

¿Control de identidad obligatorio para usar cualquier ordenador?

Además de esta trifulca Anthropic/Pentágono, otro titular10 ha llamado la atención de toda la prensa tecnológica: una nueva ley en el estado de California proyectada para entrar en vigor en enero de 2027 obligará a cualquier proveedor de sistemas operativos a incluir algún método de verificación de edad en el proceso de creación de cuenta.

Así, la Assembly Bill No. 1043, aprobada el pasado año, dice que un sistema operativo (tanto si es macOS, como Windows o un Linux) debe cumplir las dos siguientes condiciones:

(1): Proporcionar una interfaz accesible al configurar la cuenta que requiera que el titular indique la fecha de nacimiento, la edad o ambas del usuario de dicho dispositivo […].

(2): Proporcionar a un desarrollador que haya solicitado una señal con respecto a un usuario en particular una señal digital a través de una interfaz […] que identifique, como mínimo, cuál de las siguientes categorías corresponde al usuario: usuarios menores de 13 años, mayores de 13 años, menores de 16, al menos 16 años y menores de 18, y al menos 18 años.

Bueno, según el texto de la ley, esto no es tan dramático como han hecho parecer los tuits al respecto, al no entrar en juego el escaneo facial o el escaneo de documentos.

De lo que hablamos es de una pantalla obligatoria en la que el usuario tenga que indicar su edad (como ya ocurre, de hecho, en Windows). El usuario sigue pudiendo mentir sobre ello, y el objetivo sería censurar determinadas aplicaciones en las tiendas de apps según la edad, de forma similar a cómo se restringe el visionado de películas +18 a un menor.

Según el texto, el objetivo sería evitar que determinadas apps recolecten más información de la necesaria o razonable cuando el usuario es un menor de edad, ayudando así, de hecho, a proteger su privacidad.

No se trata por tanto de un cambio tan grave, pero sí que es una muestra más de la peligrosa tendencia hacia la desanonimización de los usuarios. Sobre todo, porque esta verificación no limitaría la entrada a una red social sino al propio sistema operativo entero. Aunque Windows ya pide introducir la edad al crear una cuenta, para los colectivos defensores de Linux, por ejemplo, la idea resulta estúpida.

Como señala @cyber_razz:

“Forzar la verificación de edad en Linux también debilitaría la seguridad, añadiendo nuevas rutas de código, dependencias y datos de identidad a sistemas que priorizan el minimalismo y el control. Se pueden regular las plataformas. No se puede regular una infraestructura de código abierto como Linux en el momento de la instalación”.

Tal y como lamentan desde la Electronic Frontier Foundation11, 2025 fue el año de la vigilancia, y de momento, tanto Estados Unidos como la UE buscan aumentar el control sobre los usuarios en redes sociales o plataformas.

Statement from Dario Amodei on our discussions with the Department of War. https://www.anthropic.com/news/statement-department-of-war

Pentagon official lashes out at Anthropic as talks break down: “You have to trust your military to do the right thing”. https://www.cbsnews.com/news/pentagon-anthropic-feud-ai-military-says-it-made-compromises/

Artificial Intelligence Strategy for the Department of War. https://media.defense.gov/2026/Jan/12/2003855671/-1/-1/0/ARTIFICIAL-INTELLIGENCE-STRATEGY-FOR-THE-DEPARTMENT-OF-WAR.PDF

We Will Not Be Divided. https://notdivided.org/

“Anthropic fue la primera empresa de inteligencia artificial autorizada a ofrecer servicios en redes clasificadas, a través de Palantir, que se asoció con ella en 2024. Palantir afirmó en un anuncio de la asociación que Claude podría utilizarse “para respaldar operaciones gubernamentales, como el procesamiento rápido de grandes cantidades de datos complejos”.

Tensions between the Pentagon and AI giant Anthropic reach a boiling point. https://www.msn.com/en-us/news/us/tensions-between-the-pentagon-and-ai-giant-anthropic-reach-a-boiling-point/ar-AA1WKQzE

US used Anthropic’s Claude during the Venezuela raid, WSJ reports. https://www.reuters.com/world/americas/us-used-anthropics-claude-during-the-venezuela-raid-wsj-reports-2026-02-13/

“A new California law says all operating systems, including Linux, need to have some form of age verification at account setup”. https://www.pcgamer.com/software/operating-systems/a-new-california-law-says-all-operating-systems-including-linux-need-to-have-some-form-of-age-verification-at-account-setup/

https://www.eff.org/deeplinks/2025/12/year-states-chose-surveillance-over-safety-2025-review