Manipulación psicológica en redes, whistleblowers y ciberseguridad con IA – Crónica RootedCON 2026 Día 2

Chema Alonso comparte un modelo de IA que analiza cómo un vídeo de redes sociales intenta manipularte psicológicamente con fines políticos.

En la segunda jornada de RootedCON 2026 tuvieron lugar algunas de las charlas más esperadas, como la de riesgos en el sistema europeo de señalización de ferrocarriles o la de Chema Alonso, siempre nombre destacado en estos eventos, y se trataron temas de máxima actualidad como la integración de inteligencia artificial y sus riesgos o la protección de los denunciantes de malas prácticas empresariales.

Esta es la crónica de mi segundo día merodeando la Rooted.

Inteligencia artificial, ¿imprescindible y limitada a la vez?

Las tres primeras charlas que vi versaban sobre IA, y según el ponente, podíamos conocer sus limitaciones, sus ángulos ciegos, o sus promesas.

Mario Álvarez Fernández (Pingüino de Mario en redes) llevó a cabo una pequeña demostración de cómo la IA se queda corta a la hora de analizar y reparar riesgos de seguridad en webs.

En su ponencia “Límites actuales de los LLMs en la corrección de vulnerabilidades”, Álvarez argumentó que a veces la IA fallaba al encontrar y diagnosticar riesgos de seguridad en una web. Por tanto, la supervisión humana sigue siendo imprescindible en pentesting.

Por otra parte, Víctor Mayoral, de Alias Robotics, aseguró convincente que nos dirigimos a la ciberseguridad agéntica. En “Cybersecurity AI (CAI): ciberseguridad agéntica y superinteligencia”, Mayoral asegura que los agentes de IA van a ser el componente no solo imprescindible, sino principal de los equipos de ciberseguridad dentro de muy poco: “Para 2028, la IA tomará el espacio ciber, con humanos teleoperando”, señaló.

“Tenéis que crear agentes si queréis dedicaros a este sector”

El ingeniero indicó que precisamente los gobiernos están acelerando la adopción con su apuesta por la IA, y que la velocidad sobrehumana será necesaria para luchar contra los hackers armados con IA: mientras que actualmente el plazo entre el descubrimiento de un zero day y su explotación es de 1,6 días, para finales de 2026 se espera que esta horquilla se reduzca a 1 hora, y para 2028, a un minuto.

“Tenéis que crear agentes si queréis dedicaros a este sector”, aseveró, lo que va en línea con la propuesta de negocio de su empresa: Alias ofrece un framework de creación de agentes ciber personalizados, con un modelo de pago de suscripción fija ya que, según Mayoral, “pagar por tokens es extremadamente caro”.

“La autonomía es un término marketiniano, lo autónomo en ciberseguridad no existe”

“Los datos son el nuevo petróleo, y la IA la nueva electricidad”, se leía en su presentación. El experto tiene claro que “la siguiente vertical de la IA, después de los chatbots y el coding, es la ciberseguridad”.

No obstante, alertó del riesgo de despreocuparse con el uso de agentes. “La autonomía requiere de comportamiento adaptativo”, cosa en la que la IA todavía no es buena. “La autonomía es un término marketininao, lo autónomo en ciberseguridad no existe”, aseguró.

Mayoral sacó pecho de sus modelos, presumiendo de que superaban a Claude o a ChatGPT en diversas métricas.

Paralelamente, en una tercera ponencia pudimos conocer los riesgos que precisamente conllevan los agentes de IA, no especializados en ciber sino en general.

Pablo González y Laura Lacarra, de Telefónica, nos contaron la facilidad con la que algunos agentes ponen en riesgo datos sensibles. En la charla “Does your AI agent know too much?”, los telefónicos pusieron de ejemplo la terrible gestión de la información en la que incurría la primera versión de OpenClaw, llamada Clawdbot, que filtró muchísima información personal a los cibermalos.

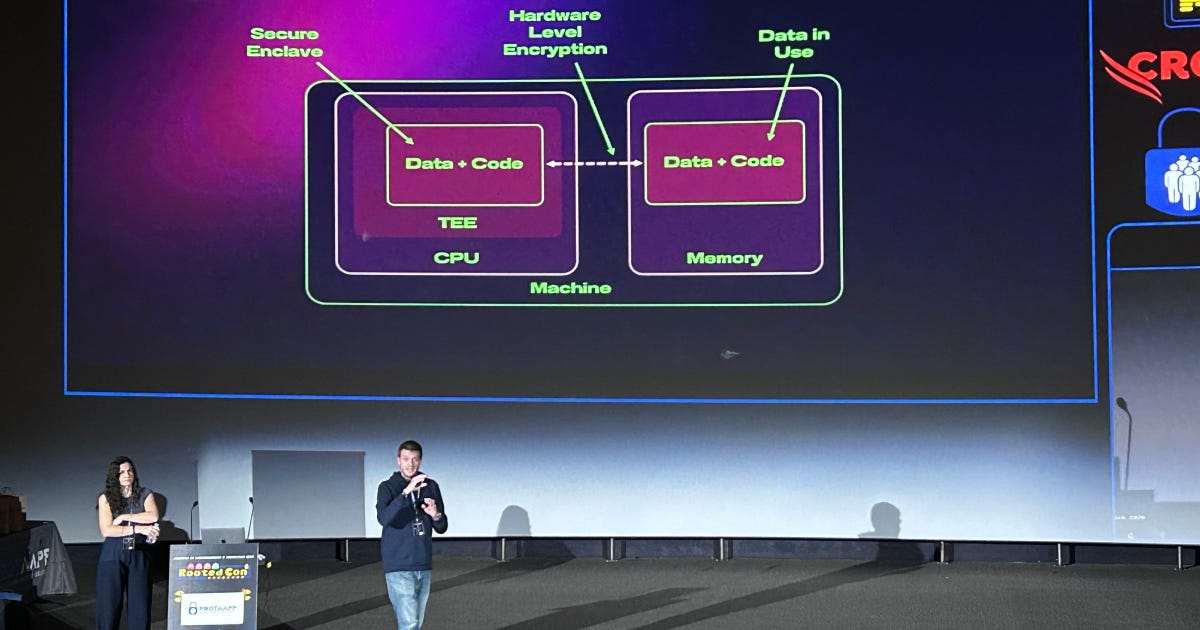

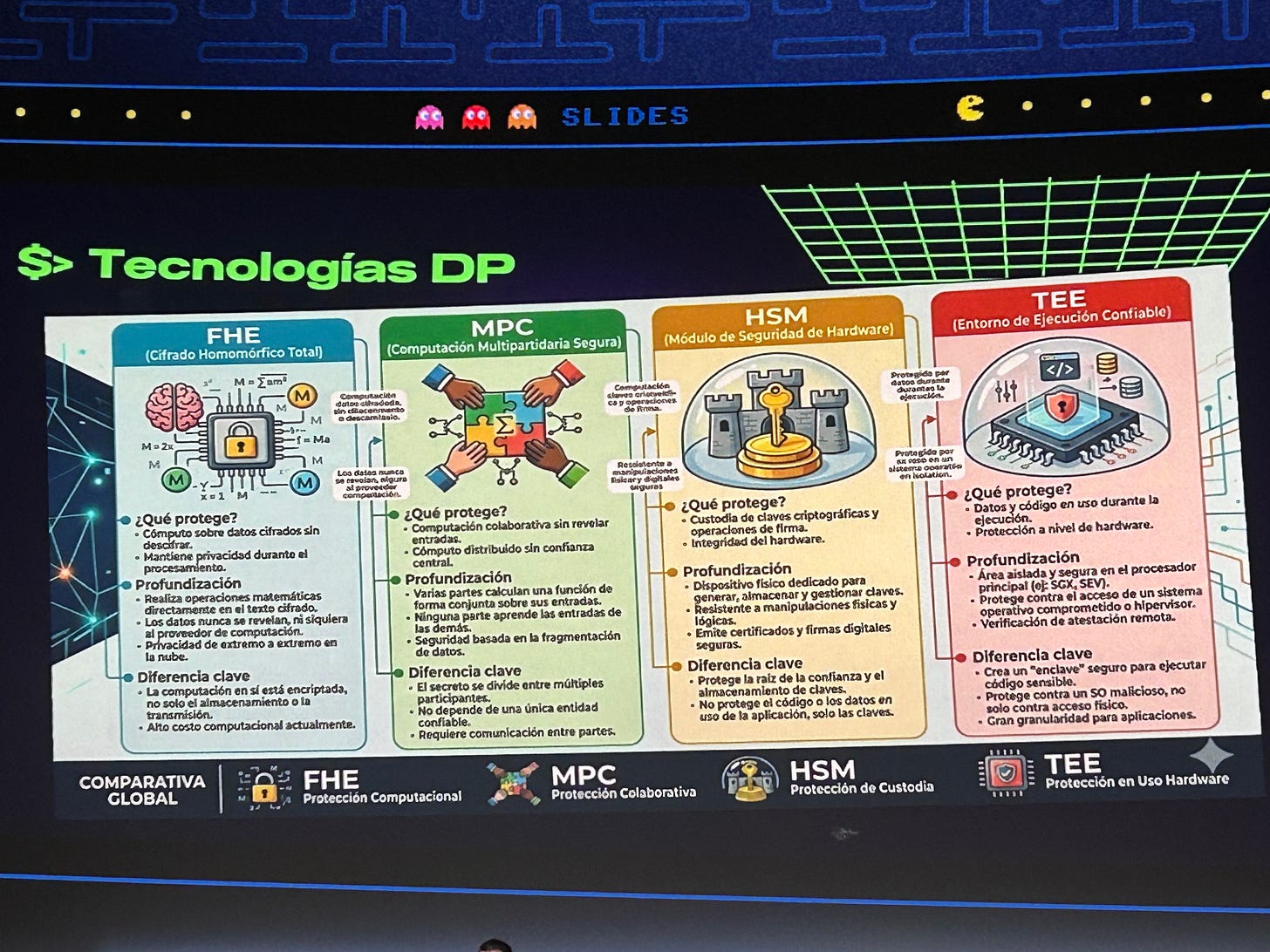

Como solución a este problema, González y Lacarra proponen el Confidential Computing, capaz de cifrar los datos en memoria RAM que la IA necesita tener a mano, al crear espacios de ejecución confiable. Mediante el proceso de “attestation”, es posible validar que los datos transferidos a otra máquina o proceso se mantendrán en uno de estos espacios seguros, evitando leaks.

“El spam telefónico no muere, solo evoluciona”

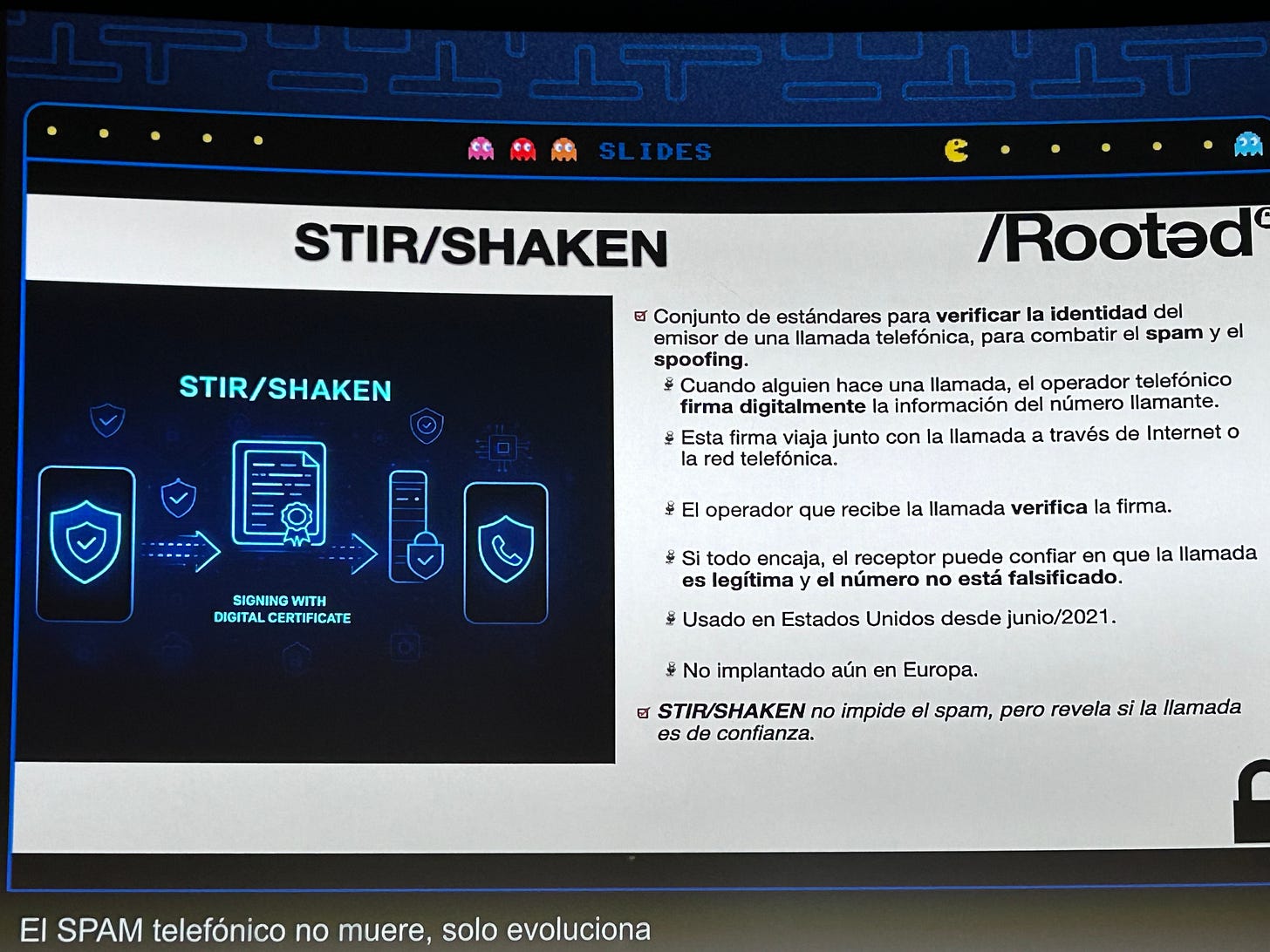

Cambiando de tema, en la ponencia de José Luis Verdeguer (@pepeluxx en redes) obtuvimos una vista global del problema actual con las robocalls y el espacio telefónico. Aunque quizá no fuera una de las ponencias con más visitantes, el problema a tratar está de plena actualidad y es, de hecho, muy grave, ya que hablamos de una pérdida de confianza total en un sistema de comunicación tan básico para un país como es la telefonía.

Verdeguer hizo un excelente repaso histórico desde la transición de la telefonía analógica a la digital hasta la actual proliferación de VoIP (voz por Internet), pasando por el fin del monopolio de Telefónica en 1998 y la explosión de los call centers gracias a los diales predictivos.

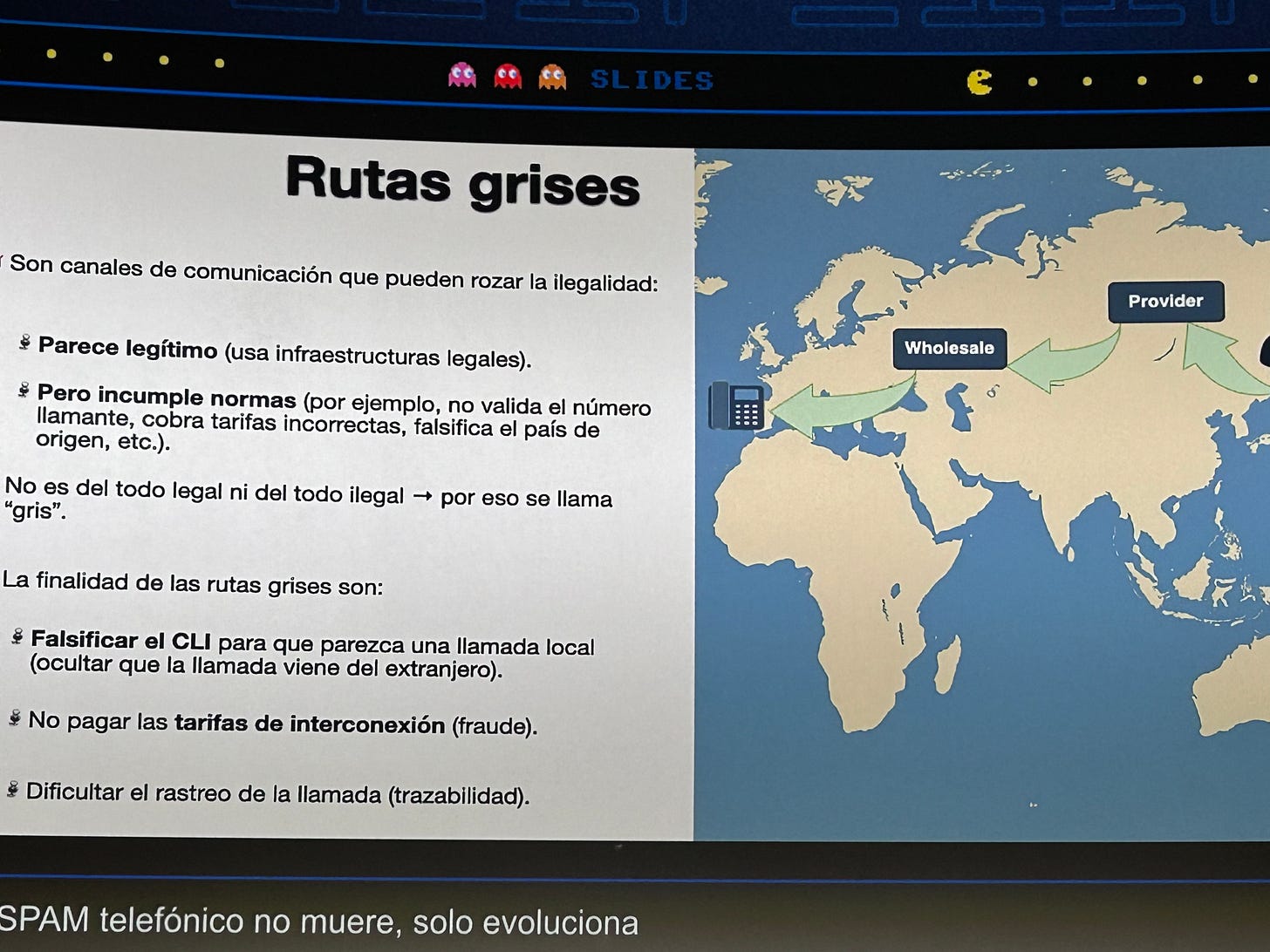

El diagnóstico del problema es el de un coste prácticamente gratuito para llamar por Internet, el uso de “rutas grises” entre países que se saltan la legislación, empresas falsas y el uso de simboxes.

El resultado: Más de 25 años de lucha contra el spam telefónico que no han terminado de solucionar el problema, con una Ley General de Telecomunicaciones siempre por detrás, y multas irrisorias a las compañías culpables.

Si bien la ley prohíbe las llamadas comerciales sin consentimiento, las robocalls se extienden como la espuma y se escapan de la ley porque no venden un servicio en concreto, sino que ofrecen estafas como supuestas oportunidades de inversión, falsas entrevistas de trabajo, etcétera.

Con la inteligencia artificial mejorando cada vez más su capacidad para imitar voces humanas, es necesario atajar este problema cuanto antes.

Verdeguer propone imponer mas requisitos por parte de la CNMC para no autorizar a operadores ilegales, un control mas estricto de rutas, listas dinámicas de spam, uso de IA para clasificación de llamadas y uso de firmas digitales STIR/SHAKEN.

Hacking en Linux

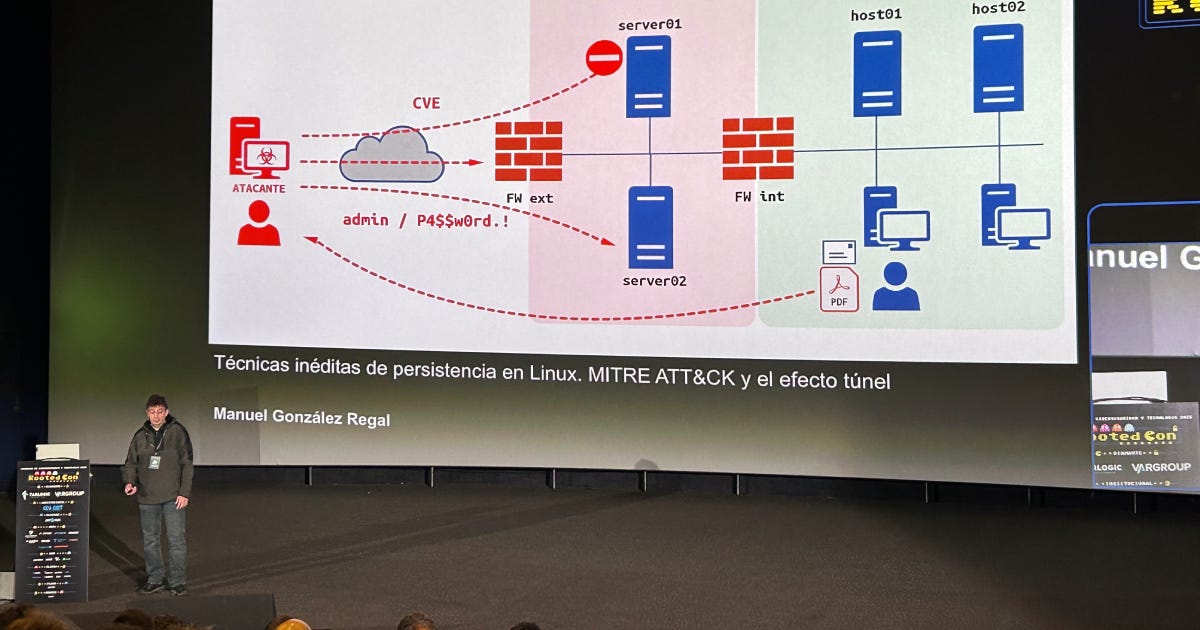

En una de las mejores charlas para los más amantes del hacking, Manuel González Regal enseñó “Técnicas inéditas de persistencia en Linux" que merecieron el aplauso de la sala.

El experto demostró varias formas de conseguir permanecer en control de un ordenador infectado utilizando un software tan común como el servidor SSHD de Secure Shell. Según Regal, solo hacía falta leer el manual oficial de este programa (sshd_config) para dar con varios puntos débiles. Sus técnicas se basaban simplemente en pervertir la directiva oficial del programa.

Recordemos que persistencia es “garantizar el permanente acceso a un sistema, pese a cambios de contraseña, reinicios u otras modificaciones”.

Mediante sshd, Regal encontró varias formas de ejecutar comandos o modificar puertos. Algunas de las tácticas consistían en aprovechar la ejecución disparada por eventos, en usar fail2ban o en editar variables de entorno en lugar de archivos muy monitorizados como systemd.

Defender la ética, proteger a los denunciantes

En “The Artificial Intelligence Act & The Whistleblower tool”, la presidenta de la Asociación de Internautas, Ofelia Tejerina, defendió la necesidad de crear, paralelamente a los canales internos dentro de empresas, canales públicos de denuncia seguros y privados, de forma que sean los propios empleados los que puedan avisar de situaciones irregulares sin tener que esperar a que la Justicia actúe.

En conversación con los asistentes, salió el tema de los whistleblowers del fabricante aeroespacial Boeing (que denunciaron malas prácticas de seguridad que podrían haber llevado a accidentes en sus aviones) y sus repentinos fallecimientos. Sin querer entrar en lo conspiranoico, Tejerina señaló que los canales de denuncia seguros garantizan que el empleado pueda denunciar malas praxis sin miedo a represalias por parte de sus jefes.

“No todo el mundo tiene el valor de denunciar a los malos”, dijo. No obstante, confesó que ciertamente los canales suelen tener algún fallo que, de alguna manera, acaban haciendo posible la identificación del denunciante anónimo, poniéndole en riesgo.

Pese a las deficiencias de este tipo de canales, como el que se ha introducido en el reglamento europeo AI Act1, Tejerina asegura que estamos mejor con leyes que sin ellas, y que son útiles aunque no funcionen al 100%. Así, defendió la regulación en esta materia por parte de la UE.

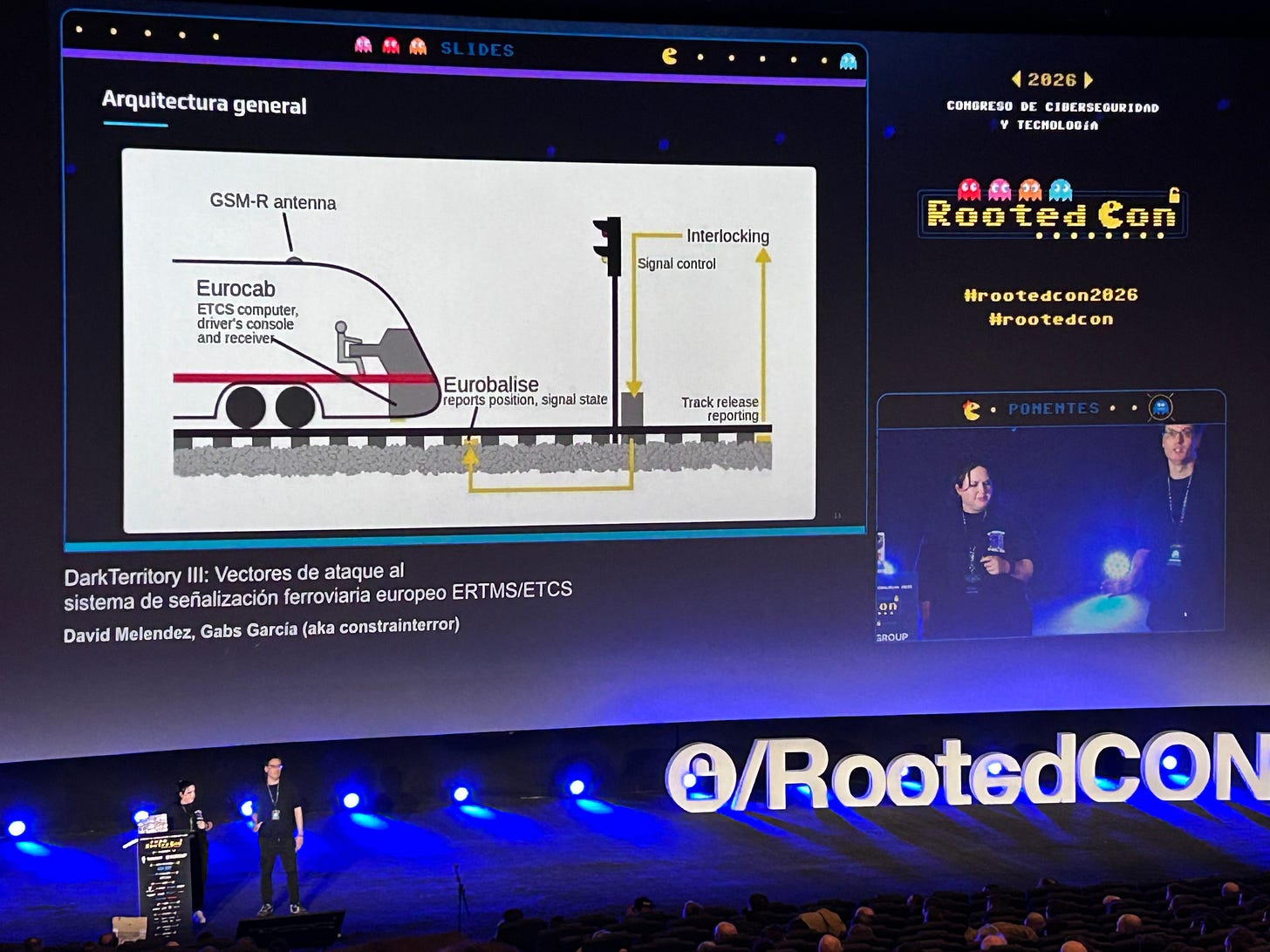

Cuidadito con los trenes

Ya cerca del fin de la jornada, tomaron una sala principal bien llena David Melendez y Gabs García (aka constrainterror), para dar una de las ponencias más esperadas: “Dark Territory III: Vectores de ataque al sistema de señalización ferroviaria europeo ERTMS/ETCS”.

Aquí he de pedir perdón al lector, porque entre el cansancio acumulado y la alta complejidad técnica, me fue imposible quedarme con nada más que con la idea de que algo puede pasar, y que la mayoría de ponentes asistentes a la RootedCON han evitado usar el tren como medio de transporte. El sistema ferroviario tiene trabajo por hacer en materia de ciber.

Manipulación y desinformación en redes sociales

Finalmente, el cierre lo pone Chema Alonso con una ponencia de nombre bastante críptico: “A Public Hacker in the Age of AI”. El extelefónico usa el espacio de RootedCON para enseñar un modelo de IA llamado Retórica capaz de analizar un vídeo de redes sociales y, basándose en una clasificación psicológica de miedos humanos, analizar de qué manera el vídeo busca manipular al espectador.

Aunque iniciativas como esta pueden ser buenas herramientas contra la desinformación y las fake news, no quedó del todo claro cómo esta IA distingue entre el miedo real y entendible de una noticia agria o el miedo ficticio insuflado por bulos políticos, pudiendo pecar de equidistante.

La ponencia fue interesante por tratar un tema de rabiosa actualidad como es el contenido basura y la desinformación política en redes, aunque las autorreferencias que hizo a noticias falsas que él protagonizaba, así como las varias referencias a su propio servicio MyPublicInbox, volvieron a demostrar que Alonso padece un problema de egocentrismo. Además, los minutos que dedicó a explicar el caso Cambridge Analytica me parecieron caducos, siendo este un asunto muy viejo (2018) y conocido de sobra por todos.

Una conclusión interesante de su estudio fue la de que los medios de derechas se apoyan más en miedos más primitivos y físicos (como la extinción, separación o mutilación), mientras que los escorados a la izquierda usan más miedos sociales como la pérdida de autonomía o la muerte del ego.

—

Muchas gracias a RootedCON por facilitar a ANTINODO la asistencia al evento.

—

Otras imágenes del evento:

“Commission launches whistleblower tool for AI Act”. https://digital-strategy.ec.europa.eu/en/news/commission-launches-whistleblower-tool-ai-act